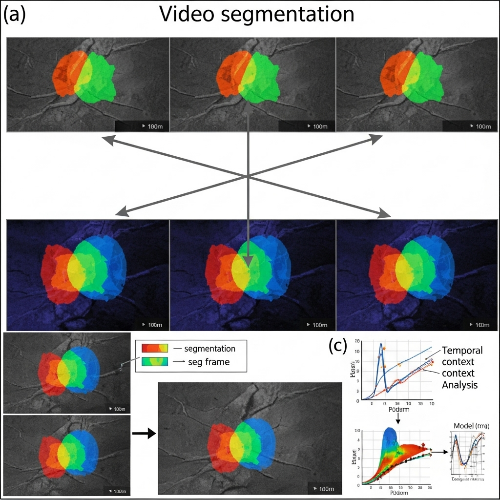

비디오 세분화(Video Segmentation)란 무엇인가?

비디오 세분화(Video Segmentation)는 연속된 비디오 프레임에서 객체를 식별하고 구분하는 컴퓨터 비전 기술입니다. 일반적인 이미지 세분화가 단일 이미지의 각 픽셀을 분류하는 데 초점을 맞춘다면, 비디오 세분화는 시간의 흐름에 따른 프레임 간 관계를 고려하여 일관성 있는 객체 구분을 목표로 합니다. 이는 자율 주행, 감시 시스템, 증강 현실(AR), 영화 후처리 등 다양한 분야에서 필수적인 기술로 활용됩니다.

시간 맥락의 중요성

프레임 간 연속성의 필요성

비디오는 수천에서 수만 개의 프레임으로 구성되며, 각 프레임은 시간에 따라 연속적으로 이어집니다. 객체의 움직임, 조명의 변화, 시점의 변화가 발생함에 따라 동일한 객체라도 프레임마다 다른 모습으로 나타날 수 있습니다. 따라서 단일 프레임 기반의 처리만으로는 정확한 세분화를 유지하기 어렵습니다.

시간 정보를 고려한 세분화 기법

시간 맥락을 반영한 기법들은 개별 프레임뿐 아니라 인접 프레임의 정보를 함께 사용하여 세분화의 정확성과 일관성을 높입니다. 이때 주로 사용되는 기술로는 순환 신경망(RNN), LSTM(Long Short-Term Memory), 3D CNN(Convolutional Neural Network), Transformer 기반 구조 등이 있습니다.

비디오 세분화를 위한 주요 기술

1. Optical Flow 기반 방법

Optical Flow는 인접 프레임 사이의 픽셀 이동 벡터를 계산하여 객체의 움직임을 추적합니다. 이 정보를 활용하면 한 프레임에서 세분화된 객체가 다음 프레임에서 어느 위치로 이동했는지를 추정할 수 있어 시간 연속성을 유지할 수 있습니다.

2. 3D CNN

3D CNN은 시간축을 포함한 3차원 커널을 사용하여 연속된 프레임의 공간적-시간적 특징을 동시에 학습합니다. 이를 통해 개별 프레임 간 상관관계를 포착하고, 움직임에 강인한 세분화 결과를 생성합니다.

3. RNN과 LSTM

RNN과 LSTM은 시퀀스 데이터를 처리하는 데 강점을 가진 네트워크입니다. 비디오 세분화에서는 연속된 프레임들의 시퀀스를 입력으로 받아 과거 프레임의 정보를 누적 학습하여 현재 프레임의 세분화에 반영합니다.

4. Transformer 기반 접근

최근에는 Transformer 모델이 비디오 세분화에 적용되고 있습니다. 이 모델은 Attention 메커니즘을 통해 프레임 간 장기적인 의존 관계를 학습하며, 특히 복잡한 장면 전환이나 빠른 객체 이동에서도 우수한 성능을 보입니다.

실제 적용 사례

자율 주행 차량

비디오 세분화는 자율 주행 시스템에서 도로의 차선, 보행자, 차량 등의 객체를 정확히 인식하고 추적하는 데 사용됩니다. 시간 맥락을 고려하면 짧은 가림 현상(occlusion)이나 빠른 움직임에도 안정적인 인식을 유지할 수 있습니다.

감시 시스템

CCTV 영상 분석에서 시간 연속성을 고려한 세분화는 사람이나 물체의 이동 경로를 정확히 파악하고, 이상 행동을 탐지하는 데 기여합니다.

AR 및 VR

증강 현실(AR)과 가상 현실(VR)에서도 객체와 배경의 실시간 분리는 필수적입니다. 시간 정보를 활용한 비디오 세분화는 사용자와 환경 간의 상호작용을 보다 자연스럽게 만듭니다.

현재 기술의 한계와 해결 방안

한계점

- 계산 비용: 시간 맥락을 처리하기 위한 모델은 높은 연산 자원을 요구합니다.

- 실시간성 부족: 고해상도 비디오를 실시간으로 처리하기에는 현재 기술이 아직 완벽하지 않습니다.

- 데이터 부족: 프레임 간 연속성이 잘 보존된 대규모 라벨링 데이터셋의 부재가 성능 향상의 걸림돌입니다.

해결 방안

- 경량화된 네트워크 설계(MobileNet, EfficientNet 등)를 활용해 연산 비용을 줄입니다.

- 비지도 학습 및 준지도 학습을 통해 라벨링 데이터의 부족 문제를 완화합니다.

- 하드웨어 가속기(GPU, TPU)와 병렬 처리 기술을 접목해 실시간 처리 성능을 높입니다.

미래 전망

딥러닝과의 융합 심화

Transformer 기반의 구조와 비디오 전용 대규모 데이터셋이 지속적으로 개발되면서, 비디오 세분화의 정확도는 더욱 향상될 것입니다.

Edge Computing과의 결합

실시간 처리를 위해 Edge Device 상에서도 동작 가능한 비디오 세분화 모델이 등장할 것으로 예상됩니다. 이는 자율 주행 차량이나 스마트 시티 등 응용 분야에서 필수적입니다.

멀티모달 학습

비디오 세분화는 앞으로 영상뿐 아니라 음성, 센서 데이터와의 통합 처리로 발전할 가능성이 큽니다. 이를 통해 보다 정교하고 복합적인 분석이 가능해질 것입니다.

결론

비디오 세분화는 시간 맥락을 고려한 처리로 영상 내 객체의 지속적인 식별과 추적을 가능하게 하는 핵심 기술입니다. 기술적 도전과제가 여전히 존재하지만, AI와 컴퓨팅 기술의 발전으로 이 한계는 점차 극복될 것입니다. 자율 주행, 감시 시스템, AR/VR 등에서 그 활용도는 앞으로도 빠르게 확대될 것으로 보입니다.

'컴퓨터 비전 & AI > 영상 분할과 분석' 카테고리의 다른 글

| 3D Semantic Segmentation: 포인트 클라우드 분할 기법 (2) | 2025.07.13 |

|---|---|

| Domain Adaptation Segmentation: 도메인 간 갭 줄이기 (2) | 2025.07.13 |

| Interactive Segmentation: 사용자 입력 기반 분할 툴 개발 (0) | 2025.07.08 |

| Segmentation in Medical Images: U‑Net 활용법 (0) | 2025.07.06 |

| DeepLabv3+ 실사 적용 사례와 최적화 팁 (0) | 2025.07.06 |