Panoptic Segmentation이란 무엇인가?

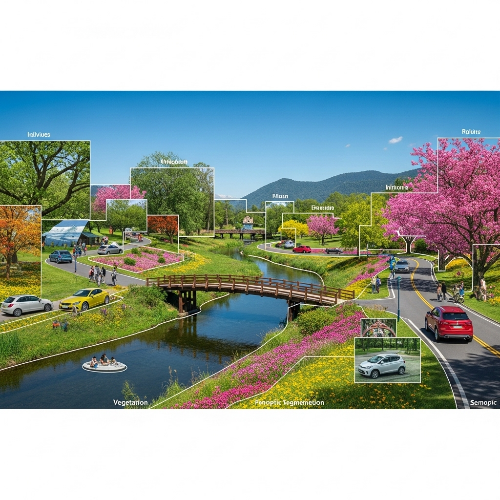

컴퓨터 비전 분야는 지난 수년간 놀라운 발전을 이루었으며, 그 중심에는 이미지와 영상 데이터를 이해하기 위한 다양한 기법들이 있습니다. Panoptic Segmentation은 이러한 기술의 발전을 한 단계 끌어올린 개념으로, 이미지 내 모든 픽셀을 객체와 배경의 구분 없이 식별하여 장면을 전체적으로 이해할 수 있게 합니다.

이 기술은 전통적인 객체 탐지(Object Detection), 인스턴스 세분화(Instance Segmentation), 그리고 **세멘틱 세분화(Semantic Segmentation)**의 장점을 결합한 형태로 볼 수 있습니다. 결과적으로 단일 이미지에서 ‘모든 것’을 인식하고 각 픽셀에 의미 있는 레이블을 부여함으로써 보다 심층적이고 종합적인 장면 이해가 가능합니다.

기존 세분화 기법과의 비교

세멘틱 세분화(Semantic Segmentation)

세멘틱 세분화는 이미지의 모든 픽셀에 클래스 레이블을 부여합니다. 예를 들어 ‘사람’, ‘나무’, ‘건물’ 등의 범주로 구분하지만 동일한 클래스 내에 여러 객체가 있을 경우 개별 객체를 식별하지 못합니다.

인스턴스 세분화(Instance Segmentation)

인스턴스 세분화는 동일한 클래스의 여러 객체를 구분합니다. 사람 A와 사람 B를 각각 별개의 객체로 인식할 수 있지만, 클래스가 아닌 개별 객체 중심의 정보만 제공합니다.

Panoptic Segmentation의 차별점

Panoptic Segmentation은 두 접근 방식을 통합합니다. 즉, 세멘틱 세분화의 포괄성과 인스턴스 세분화의 세밀함을 모두 반영하여 각 픽셀에 대해 "클래스 레이블 + 인스턴스 ID"를 부여합니다. 이를 통해 배경과 객체를 동시에 인식하고, 동일한 클래스의 여러 인스턴스를 명확히 구분할 수 있습니다.

Panoptic Segmentation의 작동 원리

Panoptic Segmentation의 핵심은 이미지 내의 픽셀을 thing(객체)과 stuff(배경)으로 구분하는 것입니다.

- Thing: 자동차, 사람, 동물처럼 독립적으로 구분 가능한 개별 객체

- Stuff: 도로, 하늘, 잔디처럼 경계가 명확하지 않고 연속적인 영역

모델은 두 가지 영역을 동시에 탐지하고, 이를 통합해 단일 장면에 대한 종합적인 이해를 생성합니다. 대표적인 구현 방식으로는 Mask R-CNN 기반의 접근법과 Fully Convolutional Network(FCN) 기반의 세멘틱 세분화를 조합하는 구조가 있습니다.

주요 기술과 알고리즘

Mask R-CNN의 확장

Mask R-CNN은 인스턴스 세분화에 강력한 성능을 보입니다. 여기에 세멘틱 세분화 헤드를 추가하여 thing과 stuff를 동시에 처리할 수 있는 Panoptic Segmentation 모델이 탄생했습니다.

EfficientPS

EfficientPS는 연산 효율성과 정확도를 동시에 고려한 모델로, 경량화된 네트워크 구조를 통해 모바일 환경에서도 Panoptic Segmentation을 가능하게 합니다.

Detectron2

Facebook AI Research(Fair)가 개발한 Detectron2는 Panoptic Segmentation의 강력한 오픈소스 구현체를 제공합니다. 다양한 데이터셋과 아키텍처를 지원하여 연구와 실무 적용에 적합합니다.

Panoptic Segmentation의 응용 분야

자율주행 차량

자율주행 시스템은 주변 환경을 실시간으로 정확하게 인식해야 합니다. Panoptic Segmentation은 도로, 차선, 차량, 보행자, 신호등 등 모든 요소를 통합적으로 분석해 보다 안전한 주행을 가능하게 합니다.

로봇 비전

서비스 로봇이나 산업용 로봇이 작업 환경을 이해하고 물체를 조작하는 데 유용합니다. 배경과 객체를 구분하고 상호 작용 가능한 대상들을 식별할 수 있습니다.

스마트 시티 및 감시 시스템

도시 환경의 영상 데이터 분석에 활용되어 교통 관리, 군중 분석, 이상 상황 감지 등 다양한 시나리오에 대응할 수 있습니다.

증강현실(AR) 및 가상현실(VR)

사용자의 시야에 존재하는 모든 객체와 배경을 정밀하게 인식하여 현실과 가상의 요소를 자연스럽게 결합할 수 있습니다.

Panoptic Segmentation의 도전 과제와 미래 전망

도전 과제

- 계산 비용: 두 가지 세분화 과정을 병행 처리해야 하므로 높은 연산 자원이 요구됩니다.

- 데이터셋 한계: thing과 stuff를 동시에 라벨링한 대규모 데이터셋이 상대적으로 부족합니다.

- 실시간 처리: 특히 자율주행과 같이 실시간성이 중요한 분야에서 속도 최적화가 필요합니다.

미래 전망

- 모델 경량화: MobileNet, EfficientNet 기반의 경량화된 아키텍처가 활발히 연구 중입니다.

- 멀티모달 통합: LiDAR, RADAR와 같은 센서 데이터와 결합하여 입체적 장면 이해가 가능할 것으로 기대됩니다.

- 자율학습: 적은 양의 라벨링 데이터로도 고성능을 발휘하는 자율 학습형 Panoptic Segmentation 모델이 주목받고 있습니다.

결론

Panoptic Segmentation은 컴퓨터 비전 분야에서 장면 이해의 새로운 패러다임을 제시하고 있습니다. 객체와 배경을 구분하지 않고 통합적으로 분석하는 능력은 자율주행, 스마트 시티, 로봇 공학 등 다양한 산업에 혁신을 가져올 것입니다. 앞으로 연산 효율성과 데이터셋 확충, 실시간 처리 능력의 개선이 병행된다면 이 기술은 일상 속으로 더욱 빠르게 스며들 것입니다.

'컴퓨터 비전 & AI > 영상 분할과 분석' 카테고리의 다른 글

| Segmentation in Medical Images: U‑Net 활용법 (0) | 2025.07.06 |

|---|---|

| DeepLabv3+ 실사 적용 사례와 최적화 팁 (0) | 2025.07.06 |

| Open‑Set Segmentation: ‘미지’ 객체 처리법 (0) | 2025.07.05 |

| Weakly-Supervised Segmentation: 약어노테이션 학습법의 이해 (2) | 2025.07.05 |

| Few-Shot Segmentation: 소량 데이터로 분할 학습하기 (4) | 2025.07.04 |