들어가며

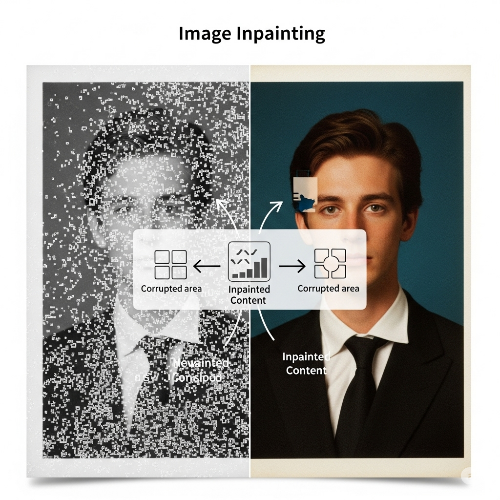

Image Inpainting(이미지 인페인팅)은 손상되거나 누락된 이미지 영역을 주변 정보를 활용하여 자연스럽게 복원하는 컴퓨터 비전 기술입니다. 고전 미술 작품 복원, 디지털 포토 편집, 불필요한 객체 제거, 의료 영상 분석 등 다양한 분야에서 활용되고 있으며, 특히 최근 딥러닝 기술의 발전으로 놀라울 정도로 자연스러운 결과를 달성할 수 있게 되었습니다.

Image Inpainting의 기본 개념

정의와 목표

Image Inpainting은 이미지의 특정 영역이 손상되거나 제거된 상황에서, 주변의 시각적 정보와 전체적인 맥락을 바탕으로 누락된 부분을 예측하고 복원하는 기술입니다. 이는 본질적으로 한정된 정보로부터 무한한 가능성을 추론하는 문제로, 단순한 픽셀 채우기를 넘어서 의미론적으로 일관된 결과를 생성해야 합니다.

주요 도전 과제

Inpainting에서 가장 큰 도전은 **semantic consistency(의미적 일관성)**와 **visual plausibility(시각적 그럴듯함)**을 동시에 만족시키는 것입니다. 복원된 영역이 주변과 자연스럽게 어우러지면서도 전체적인 구조와 의미를 해치지 않아야 합니다.

또한 다양한 스케일의 정보를 처리해야 하는 문제도 있습니다. 텍스처나 패턴 같은 저수준 정보부터 객체의 형태나 장면의 구조 같은 고수준 정보까지 모두 고려해야 효과적인 복원이 가능합니다.

전통적 접근법의 한계

전통적인 방법들은 PDE(Partial Differential Equation) 기반의 확산 모델이나 patch-based 방법을 사용했습니다. Telea 알고리즘이나 Navier-Stokes 방법은 작은 스크래치나 단순한 텍스처 영역에서는 효과적이지만, 복잡한 구조나 큰 영역의 복원에서는 한계를 보입니다.

Exemplar-based 방법들은 이미지 내의 유사한 패치를 찾아 복사하는 방식으로, 반복적인 텍스처에서는 좋은 결과를 보이지만 구조적 정보가 부족할 때 부자연스러운 결과를 생성합니다.

주요 기술 접근법

1. Encoder-Decoder 기반 방법

Context Encoder는 딥러닝 기반 Inpainting의 선구적 연구로, 오토인코더 구조를 사용하여 누락된 영역을 예측합니다. 인코더는 손상된 이미지에서 컨텍스트 정보를 추출하고, 디코더는 이를 바탕으로 누락된 영역을 생성합니다.

이 접근법은 global context를 효과적으로 활용할 수 있지만, 생성된 결과가 종종 흐릿(blurry)하게 나타나는 문제가 있습니다. 이는 주로 L2 손실 함수의 특성 때문으로, 여러 가능한 결과의 평균을 학습하려는 경향이 있습니다.

2. Generative Adversarial Networks (GAN)

GAN 기반 방법은 Inpainting 품질을 혁신적으로 개선했습니다. 생성자는 누락된 영역을 채우고, 판별자는 복원된 결과가 실제인지 가짜인지를 판별합니다. 이러한 적대적 훈련을 통해 더 선명하고 현실적인 결과를 생성할 수 있습니다.

Contextual Attention 메커니즘을 도입한 연구들은 복원 영역과 주변 영역 간의 관계를 더 정교하게 모델링합니다. 이를 통해 구조적 일관성을 유지하면서도 세밀한 디테일을 생성할 수 있습니다.

PatchGAN은 이미지를 작은 패치 단위로 나누어 판별하는 방법으로, 국소적인 텍스처 품질을 향상시키는 데 효과적입니다. 이는 전체 이미지 수준의 판별보다 더 세밀한 피드백을 제공합니다.

3. Attention 기반 방법

Attention 메커니즘은 복원 과정에서 가장 관련성이 높은 영역에 집중할 수 있게 해줍니다. Gated Convolution을 사용한 방법들은 각 위치에서 어떤 정보를 사용할지 동적으로 결정하여 더 정확한 복원을 가능하게 합니다.

Non-local Neural Networks를 활용한 접근법은 멀리 떨어진 영역 간의 관계도 고려하여 일관된 구조를 생성합니다. 이는 특히 반복적인 패턴이나 대칭적 구조를 가진 이미지에서 효과적입니다.

4. Transformer 기반 접근법

최근 Vision Transformer의 성공에 힘입어 Inpainting 분야에도 Transformer 아키텍처가 적용되고 있습니다. Self-attention 메커니즘을 통해 장거리 의존성을 효과적으로 모델링하고, 전체 이미지의 맥락을 고려한 복원이 가능합니다.

**MAE(Masked Autoencoder)**는 무작위로 마스킹된 이미지 패치를 복원하는 self-supervised 방법으로, 일반적인 이미지 표현을 학습하여 다양한 Inpainting 작업에 활용할 수 있습니다.

평가 지표와 품질 측정

정량적 평가 지표

**PSNR(Peak Signal-to-Noise Ratio)**과 **SSIM(Structural Similarity Index)**은 기본적인 화질 평가 지표로 사용됩니다. 하지만 이러한 픽셀 기반 지표들은 인간의 시각적 인지와 완전히 일치하지 않을 수 있습니다.

**FID(Fréchet Inception Distance)**는 생성된 이미지와 실제 이미지 간의 분포 차이를 측정하여 더 의미 있는 품질 평가를 제공합니다. **LPIPS(Learned Perceptual Image Patch Similarity)**는 사전 훈련된 네트워크의 특징을 활용하여 지각적 유사성을 측정합니다.

정성적 평가의 중요성

Inpainting에서는 시각적 일관성, 의미적 적절성, 경계 부드러움 등을 종합적으로 평가해야 합니다. **사용자 연구(User Study)**를 통한 주관적 평가가 중요한 역할을 하며, 특히 복원 결과의 자연스러움과 현실감을 평가하는 데 필수적입니다.

실제 구현 시 고려사항

마스크 처리 전략

효과적인 Inpainting을 위해서는 마스크 처리 전략이 중요합니다. Irregular mask를 사용한 훈련은 실제 사용 시나리오에 더 가까운 조건을 제공합니다. Progressive mask expansion은 작은 영역부터 시작하여 점진적으로 확장하는 방법으로, 훈련 안정성을 향상시킵니다.

Mask-aware convolution은 마스크 정보를 명시적으로 활용하여 손상된 영역과 정상 영역을 구별해서 처리합니다. 이를 통해 경계 부분에서의 아티팩트를 줄일 수 있습니다.

손실 함수 설계

Inpainting에서는 다중 손실 함수의 조합이 중요합니다. Reconstruction loss는 픽셀 수준의 정확도를 보장하고, Adversarial loss는 현실적인 텍스처 생성을 도와줍니다.

Perceptual loss는 사전 훈련된 VGG 네트워크의 특징을 활용하여 고수준 의미 정보의 일관성을 유지합니다. Style loss는 텍스처와 패턴의 일관성을 보장하는 데 효과적입니다.

데이터 증강과 전처리

다양한 마스크 패턴을 사용한 데이터 증강은 모델의 일반화 성능을 향상시킵니다. Random erasing, regular pattern masking, object-aware masking 등을 조합하여 다양한 시나리오에 robust한 모델을 만들 수 있습니다.

Multi-scale training은 다양한 해상도에서 훈련하여 여러 스케일의 구조를 효과적으로 학습할 수 있게 합니다.

응용 분야별 특화 기술

포토 편집 및 객체 제거

Object removal은 Inpainting의 가장 직관적인 응용 분야입니다. Semantic segmentation과 결합하여 특정 객체를 자동으로 탐지하고 제거하는 시스템이 개발되고 있습니다. 이때 배경 복원과 그림자 제거가 핵심 기술입니다.

Real-time inpainting을 위한 경량 모델들은 모바일 앱이나 실시간 비디오 편집에 활용됩니다. MobileNet 기반의 효율적인 아키텍처와 knowledge distillation을 통해 성능과 속도의 균형을 맞춥니다.

문화유산 복원

디지털 아트 복원에서는 작품의 역사적 정확성과 예술적 가치를 보존하는 것이 중요합니다. Domain-specific knowledge를 활용한 specialized model들이 개발되고 있으며, 미술사 전문가의 피드백을 반영한 human-in-the-loop 시스템이 사용됩니다.

Crack detection and inpainting은 균열이나 손상된 부분을 자동으로 탐지하고 복원하는 기술로, 보존 과학과 컴퓨터 비전의 융합 분야입니다.

의료 영상 분석

의료 영상에서는 anatomical consistency가 절대적으로 중요합니다. Prior knowledge를 활용한 방법들은 해부학적 구조를 고려하여 의학적으로 타당한 복원을 수행합니다.

Multi-modal inpainting은 CT, MRI, X-ray 등 다양한 영상 기법의 정보를 종합하여 더 정확한 복원을 가능하게 합니다. Uncertainty quantification을 통해 복원 결과의 신뢰도를 제공하는 것도 중요한 연구 방향입니다.

비디오 Inpainting

**시간적 일관성(Temporal Consistency)**은 비디오 Inpainting의 핵심 도전 과제입니다. Optical flow를 활용한 방법들은 프레임 간의 움직임을 추정하여 시간적으로 일관된 복원을 수행합니다.

3D CNN이나 Recurrent Neural Network를 사용한 방법들은 시간적 정보를 직접적으로 모델링하여 flickering이나 temporal artifacts를 줄입니다.

최신 연구 동향

Self-Supervised Learning

Contrastive learning을 활용한 방법들은 라벨이 없는 대량의 데이터를 활용하여 강력한 표현을 학습합니다. SimCLR이나 MoCo와 같은 방법들을 Inpainting에 적용하여 일반화 성능을 향상시킵니다.

Masked language modeling에서 영감을 받은 masked image modeling은 무작위로 마스킹된 이미지 패치를 복원하는 pretext task를 통해 유용한 시각적 표현을 학습합니다.

Diffusion Models

**Denoising Diffusion Probabilistic Model(DDPM)**은 최근 이미지 생성에서 뛰어난 성능을 보여주고 있으며, Inpainting에도 활발히 적용되고 있습니다. Classifier-free guidance를 활용한 방법들은 조건부 생성을 통해 더 정확한 복원을 가능하게 합니다.

Latent diffusion은 압축된 잠재 공간에서 diffusion process를 수행하여 계산 효율성을 크게 향상시킵니다.

Neural Implicit Representations

**Neural Radiance Fields(NeRF)**와 Implicit Neural Networks는 연속적인 이미지 표현을 학습하여 임의의 해상도에서 복원이 가능합니다. 이는 특히 multi-view consistency가 중요한 3D 복원 작업에 유용합니다.

Coordinate-based networks는 픽셀 좌표를 직접 입력으로 받아 해당 위치의 색상을 예측하는 방법으로, 연속적이고 해상도 독립적인 복원을 가능하게 합니다.

성능 최적화 전략

모델 경량화

Pruning과 quantization을 통해 모델 크기를 줄이면서도 성능을 유지할 수 있습니다. **Neural architecture search(NAS)**를 활용하여 특정 제약 조건 하에서 최적의 아키텍처를 찾는 연구도 활발합니다.

Separable convolution과 depthwise convolution을 활용한 효율적인 네트워크 설계는 모바일 환경에서의 실시간 처리를 가능하게 합니다.

메모리 효율성

Patch-based processing은 고해상도 이미지를 작은 패치로 나누어 처리하여 메모리 사용량을 줄입니다. Gradient checkpointing과 mixed precision training은 훈련 시 메모리 효율성을 향상시킵니다.

Progressive training은 낮은 해상도에서 시작하여 점진적으로 해상도를 높여가는 방법으로, 메모리 사용량을 줄이면서도 안정적인 학습을 가능하게 합니다.

윤리적 고려사항과 한계

딥페이크와 조작

Inpainting 기술이 발전함에 따라 이미지 조작이나 딥페이크 생성에 악용될 가능성이 증가하고 있습니다. Authenticity verification과 manipulation detection 기술의 동시 발전이 필요합니다.

Watermarking이나 blockchain 기술을 활용한 디지털 자산의 원본성 보장 방법들이 연구되고 있습니다.

편향과 공정성

훈련 데이터의 편향이 복원 결과에 영향을 미칠 수 있습니다. Bias mitigation과 fairness-aware learning을 통해 더 공정하고 균형잡힌 복원 결과를 얻을 수 있습니다.

미래 전망

통합된 멀티모달 시스템

Text-to-image inpainting은 텍스트 설명을 바탕으로 누락된 영역을 복원하는 방법으로, 사용자의 의도를 더 정확히 반영할 수 있습니다. CLIP과 같은 vision-language 모델을 활용한 연구가 활발합니다.

Interactive inpainting은 사용자의 스케치나 간단한 입력을 바탕으로 실시간으로 복원 결과를 생성하는 방법으로, 창작 도구로서의 활용 가능성이 높습니다.

실시간 처리와 하드웨어 최적화

Edge computing과 specialized hardware를 활용한 실시간 Inpainting 시스템이 개발되고 있습니다. **NPU(Neural Processing Unit)**나 GPU acceleration을 통해 모바일 환경에서도 고품질 복원이 가능해질 것입니다.

결론

Image Inpainting은 손상된 이미지를 자동으로 복원하는 강력한 기술로, 딥러닝의 발전과 함께 실용적인 수준에 도달했습니다. 단순한 텍스처 복원을 넘어서 의미론적으로 일관된 고품질 결과를 생성할 수 있게 되었으며, 다양한 분야에서 실제 활용되고 있습니다.

앞으로는 더 효율적이고 정확한 복원을 위한 새로운 아키텍처 개발, 실시간 처리 성능 향상, 그리고 윤리적 사용을 위한 가이드라인 확립이 주요 연구 방향이 될 것입니다. 특히 Diffusion model과 Transformer 기반 방법들의 융합을 통해 더욱 혁신적인 발전이 기대됩니다.

이러한 기술적 진보는 창작 도구, 문화유산 보존, 의료 영상 분석 등 다양한 분야에서 새로운 가능성을 열어줄 것이며, 우리의 디지털 경험을 더욱 풍부하고 완전하게 만들어줄 것입니다.

'컴퓨터 비전 & AI > 생성과 보정' 카테고리의 다른 글

| NeRF 기반의 Neural Rendering 기법 이해: 3D 장면 재구성의 혁신 (2) | 2025.07.16 |

|---|---|

| Image-to-Image Translation: CycleGAN, Pix2Pix 활용 사례와 혁신적 응용 (0) | 2025.07.16 |

| Facial Attribute Manipulation: 얼굴 특징 변형 구현의 혁신적 기술 (0) | 2025.07.15 |

| Style Transfer: 예술 콘텐츠 자동 생성 플랫폼의 혁신적 변화 (2) | 2025.07.15 |

| Image Super-Resolution: 현실적 이미지 고해상도 변환 (0) | 2025.07.14 |